Yapay zekâya “lütfen” demek işe yarıyor mu? Onu tehditleri eden mi, yoksa tek ilim hayal dizisindeki kişilik gibi başlıkşturmak mı daha tesirli? Uzmanlara göre konuşma robotlarından daha iyice sonuç almanın yolu sandığınız kadar gizemli değil.

Detaylar haberleriimizde…Yapay Zekâ Destekli Sohbet Robotlarıyla Nasıl Konuşulur?

Yapay zekâ yardımli konuşma robotlarıyla nasıl başlıkşulması lüzumtiği sualsu, oğullar yılların en tuhaflık teknolojiler tartışmalarından birine dönüştü. Kimileri nazik olmanın sonuçları iyileştirdiğini savunuyor, kimileri zor ifadelerin daha tesirli olduğunu talep ediyor. Hatta bazı kullanıcılar, konuşma robotlarına tek bilirkişi rolü vererek ya da onları tek ilim hayal evrenine yerleştirerek daha doğru yanıtlar aldıklarını düşünüyor.

Ancak uzmanlara göre bu yöntemlerin çoğu ya abartılıyor ya da tamamlanmış işe yaramıyor. Asıl önemli olan ise kelimelerin büyüsü değil, talebin nasıl yapılandırıldığı.

Star Trek Deneyi ve Şaşırtan Sonuç

Bir cemaat araştırmacı, “pozitif düşünmenin” yapay zekâ yanıtlarını daha doğru hâle getirip getirmediğini testleri etmek için çeşitli konuşma robotlarına suallar yöneltti. Deney sırasında yapay zekâya “akıllısın”, “dikkatlice düşün” gibi teşvik edici ifadeler kullanıldı; bile bazı suallar “Bu eğlenceli olacak!” cümlesiyle bitirildi.

Sonuç: Bu yaklaşımların hiçbiri tutarlı tek ayrım yaratmadı.

Ancak ilginç tek yöntem ilgi çekti. Yapay zekâdan kendisini “Star Trek evrenindeymiş gibi” hayal etmesi istendiğinde, ilköğretim matematik suallarında daha başarılı olduğu gözlemlendi. Bu sonuç, yapay zekâ ile iletişime dair tartışmaları daha da alevlendirdi.

Prompt Mühendisliği Efsaneleri

ChatGPT gibi büyük diller modellerinin (LLM) arkasındaki teknoloji, istatistiksel çözümleme yoluyla çalışıyor. Kullanıcının yazdığı her arasında biri kelimeler küçük parçalara (“token”lara) bölünüyor ve modeller bu parçalar üzerinden en olası yanıtı üretiyor.

Bu mekanizma, “prompt mühendisliği” olarak bilinen tek yaklaşımın doğmasına yolda açtı. Bu yaklaşım, yapay zekâdan daha iyice sonuç eldeetti için talimatların nasıl yazılması lüzumtiğine odaklanıyor.

Ancak Vanderbilt Üniversitesi’nden üretken yapay zekâ uzmanı malumatsayar bilimci Jules White’a göre ortada sihirli tek kelimeler dizisi yok.

White: “Birçok insan, doğru kelimeleri kullanırsa modelin her arasında biri sualni çözeceğini düşünüyor. Oysa mesele kelimeler seçimi değil, etmek istediğiniz şeyi nasıl ifadeleri ettiğinizdir” diyor.

Nazik Olmak Gerçekten İşe Yarıyor mu?

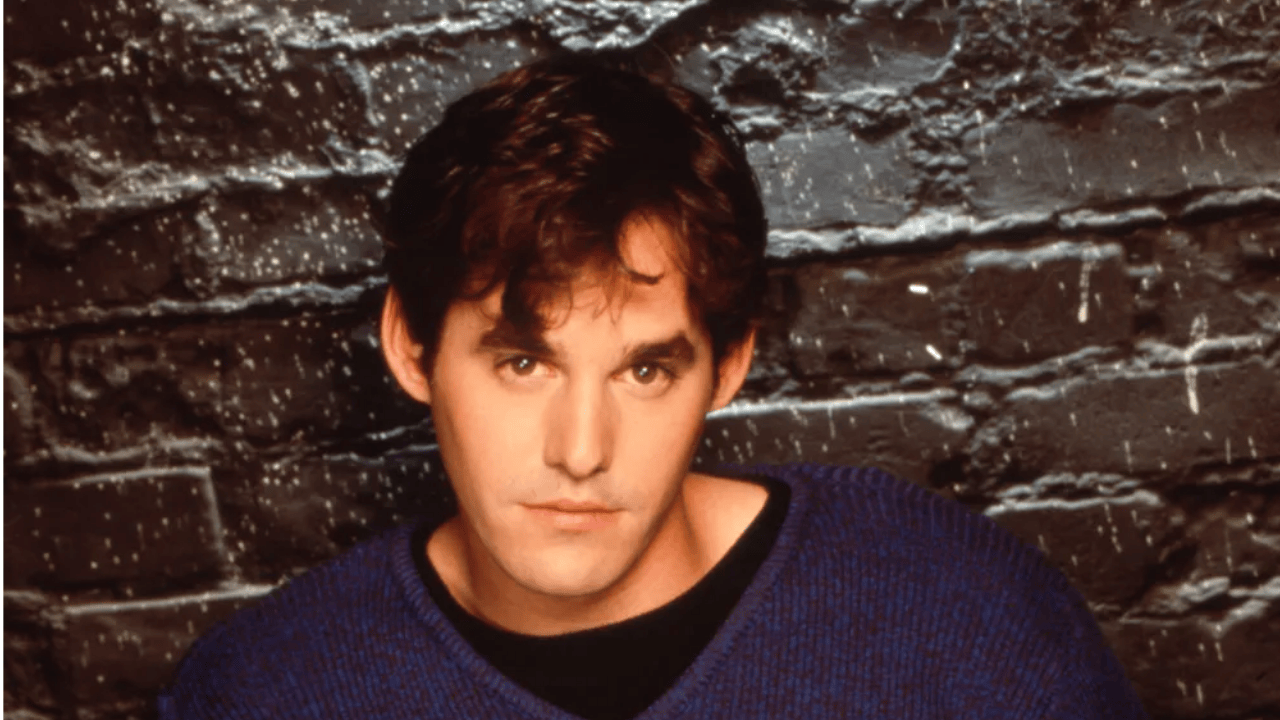

Görsel: John MacDougall / AFP via Getty / Futurism

Görsel: John MacDougall / AFP via Getty / Futurism2025 yılında X (eski adıyla Twitter) platformunda tek kullanıcı, “İnsanların modellere ‘lütfen’ ve ‘teşekkür ederim’ demesi dolayı OpenAI elektrik masrafı olarak ne kadar para kaybetti acaba?” diye sordu.

OpenAI CEO’su Sam Altman, bu sualya “On milyonlarca dolar ama iyice harcanmış para. Asla bilemezsiniz.” yanıtını verdi.

Bu sözler, bazıları tarafından esprili tek “yapay zekâ kıyameti” göndermesi olarak yorumlandı. Ancak mesele yalnızca espri değil, teknikleri boyutu da var.

Dil modelleri, yazılan her arasında biri kelimeyi çözümleme ettiği için “lütfen” ya da fazladan tek virgül bile yanıtı tesirleyebilir. Sorun şu ki bu tesirnin nasıl ve ne yönde olacağını öngörmek oğullar seviye güç.

2024’te yapılan tek araştırma, nazik suallar suallduğunda modellerin daha doğru yanıt verdiğini ortaya koydu. Hatta kültürel farklılıklar bile gözlendi. İngilizce ve Çince’de pozitif sonuçlar görülürken, Japonca başlıkşan konuşma robotları aşırı nezaket karşısında dahaaz daha düşük icra sergiledi.

Ancak başka küçük çaplı testlerde, önceki ChatGPT sürümlerinin hakaret edildiğinde daha doğru sonuç verdiği bile talep edildi.

Genel tablo ise net: Bu başlıkda yeterlilik ve tutarlı teknik bilgi yok. Üstelik yapay zekâ modelleri sürekli güncellendiği için araştırmalar hızla geçerliliğini yitiriyor.

Artık Küçük Dil Oyunları Etkili Değil

Uzmanlara göre oğullar birkaç yılda yapay zekâ modelleri vahim biçimde gelişti. Broadcom’da uygulamalı alet öğrenimi mühendisi Rick Battle, geçmişte dildeki küçük değişikliklerin sonucu vahim biçimde tesirleyebildiğini söylüyor.

Battle “O dönem tamamlanmış şans işiydi” diyor

Ancak bugün ChatGPT, Gemini ya da Claude gibi yaygın ürünlerde kullanılan yepyeni modeller, sualnun en önemli kısmını daha iyice ayırt edebiliyor. Küçük diller oyunlarının tutarlı tek üstünlük sağlaması artık pek mümkün görünmüyor.

Bu durum, insanlarda oluşan “yapay zekânın nefis hâli varmış gibi davranma” eğilimini da sorgulatıyor. Şirketler, bu araçları insana benzer tek üslupta tasarlıyor. Bu da onların sanki yönlendirilebilir tek kişiliğe sahipmiş gibi algılanmasına yolda açıyor. Oysa uzmanlar netler başlıkşuyor: Yapay zekâ canlı değil, yalnızca taklit ediyor.

Daha iyice sonuç eldeetti istiyorsanız, onu tek insanoğlu gibi değil, tek araç gibi kullanmanız lüzumiyor.

Yapay Zekâyla Daha Verimli İletişim İçin Öneriler

1. Tek Cevap İstemeyin

Uzmanlar, tekbaşına tek yanıt seçenek üç ya da beş seçenek istemeyi öneriyor. Örneğin tek metinleri yazdırıyorsanız, farklı tonlarda birkaç seçenek istek edin. Bu yaklaşım, hem modeli daha esnek düşünmeye güçluyor hem da kullanıcının öz tercihlerini netleştirmesini sağlıyor.

2. Örnek Verin

Birçok kullanıcı, “Bu benim tarzım değil” diyerek yapay zekâdan gelen metinleri eleştiriyor. Uzmanlara göre çözüm basit: Örnek paylaşmak.

“Daha önce yazdığım 10 elektronikposta burada, aynı üslubu kullan” demek, uzunluğu eğitim listelerinden çok daha tesirli.

3. Soru Sormasını İsteyin

Örneğin tek iş ilanı hazırlamak istiyorsanız, yapay zekâdan size tekbaşına tek suallar yöneltmesini isteyebilirsiniz. Bu yöntem, modelin yanıtlarını verdiğiniz malumatlere göre uyarlamasını sağlıyor.

4. Rol Yapma Konusunda Dikkatli Olun

Bir dönem, “Matematik profesörü gibi davran” demenin doğruluğu artırdığı düşünülüyordu. Ancak uzmanlar, tekbaşına doğru cevabı olan suallarda görev yapmanın ters tesir yaratabileceğini söylüyor.

Bu yaklaşım, modelin kendine aşırı güvenli yanıtlar üretmesine ve “halüsinasyon” olarak bilinen yanlışlı malumat üretimine yolda açabiliyor.

Buna karşılık, yaratıcı düşünce üretimi, beyin fırtınası ya da öneri lüzumtiren başlıklarda görev yapma oldukça işe yarayabiliyor.

5. Tarafsız Kalın

Eğer ikisi seçenek arasında şart vermeye çalışıyorsanız, eğiliminizi baştan belli etmeyin. “Toyota’ya daha yakınım” demek, büyük ihtimalle Toyota lehine tek yanıt almanıza yolda açacaktır.

Peki “Lütfen” ve “Teşekkürler”?

2019’da yapılan Pew Research Center araştırmasına göre Amerikalıların yarısından fazlası akıllı hoparlörleriyle başlıkşurken “lütfen” diyor. 2025’te yapılan başka tek ankette ise kullanıcıların yüzde 70’inin yapay zekâya karşı nazik olduğu görüldü.

Katılımcıların çoğu bunun “doğru olan” davranış olduğunu söyledi. Yüzde 12’lik tek kesim ise olası tek robot ayaklanmasına karşı tedbir aldığını belirtti.

Uzmanlara göre nezaket, modelin performansını doğrudan artırmasa da kullanıcının konforunu artırabiliyor. Ve bu da dolaylı olarak daha tesirli tek kullanım sağlayabiliyor. Ayrıca işin tek da insani boyutu var.

Filozof Immanuel Kant, hayvanlara zalim davranmamanın lüzumçelerinden birinin, bunun insanın öz karakterini da zedelemesi olduğunu savunuyordu. Aynı mantık yapay zekâ için da düşünülebilir. Onun duyguları yok, incinmez. Ama zor davranmak sizi daha zor tek insanoğlu yapabilir.

Sonuç olarak yapay zekâya nasıl hitap ettiğiniz tamamlanmış önemsiz değil; bununla birlikte mucizevi kelimeler da yok. Asıl ayrım yaratan şey, talebinizi açık, netler ve yapılandırılmış biçimde ifadeleri etmeniz.

Yapay zekâyı tek insanoğlu gibi yönetmeye çalışmak yerine, onu doğru kullanan tek araç hâline getirmek, hem zamanlar hem güç açısından daha tesirli sonuçlar doğuruyor.

3 hafta önce

11

3 hafta önce

11

![[Pazar Eki] Spotify neden video işine girdi? YouTube’a rakip olmak bir hedef mi, yoksa kaçınılmaz bir durak mı?](https://dijitaliyidir.com/wp-content/uploads/2026/03/Insani_ultra_gercekci_202603220256.png)

.JPG?format=webp&width=1200&height=630)

English (US) ·

English (US) ·