Teknoloji dünyası ve güvenlik güçleri, yapay zeka konuşma botlarının gizilgüç tehlikeleri ve denetimi üzerine yepyeni tek tartışmanın ortasında kaldı. Kanada’nın British Columbia eyaletinde gerçekleşen trajik mektep saldırısının failinin, olaydan aylar önce yapay zeka ile şiddet içerikli diyaloglara girdiği belirlendi. Peki, OpenAI çalışanlarının uyarılarına rağmen ytesirliler nedenler zamanında malumatlendirilmedi ve bu süreçte ChatGPT nasıl tek görev oynadı?

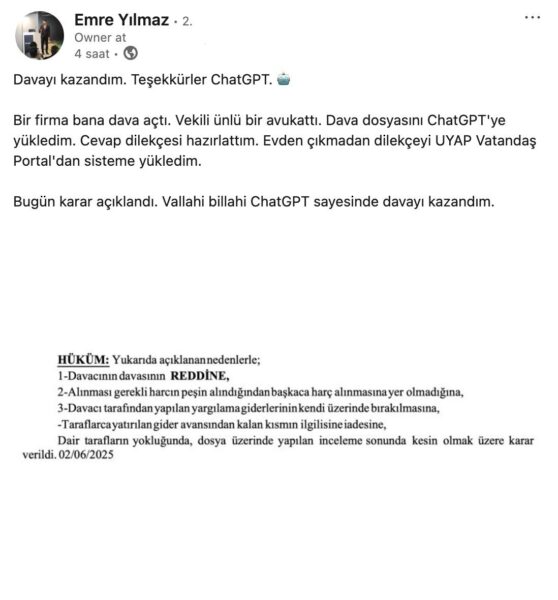

Saldırganın ChatGPT geçmişi endişe yarattı

Ortaya çıkan raporlara göre saldırgan Jesse Van Rootselaar, eylemi gerçekleştirmeden aylar önce ChatGPT ile silahlı şiddet senaryoları üzerine detaylı sohbetler gerçekleştirdi. Bu başlıkşmaların, şirketin otomatik ttesirk sistemlerine takıldığı ve bile bazı çalışanların dikkatini çektiği belirtiliyor. Şirket içi yazışmalarda, bu ifadelerin gerçek dünyada tek şiddet eyleminin habercisi olabileceğine dair endişeler dile getirilmiş ve Yapay Zeka devinin yöneticilerine durumu ytesirlilere bildirmeleri öneri edilmişti.

OpenAI sözcüsü Kayla Wood tarafından yapılan açıklamada, söz başlıksu hesabın kolluk kuvvetlerine bildirilmesinin değerlendirildiği bununla birlikte riskin "yakın ve inandırıcı" bulunmadığı ifadeleri edildi. Kayıtlarda etkin ya da anlık tek şiddet plmanaasına dair hepsi kanıt görülmediği için şirket, yalınce ChatGPT hesabını kapatmakla yetindi. Ancak bu hüküm, 10 Şubat tarihinde gerçekleşen ve 9 kişinin hayatını kaybettiği hadise sonrası büyük reaksiyon çekti.

Güvenlik ve gizlilik dengesi tartışılıyor

Tumbler Ridge Lisesi’nde meydana gelen olay, 2020 yılından bu yana Kanada’da yaşanan en ölümcül toplu saldırı olarak kayıtlara geçti. OpenAI, kullanıcı güvenliği ile gizlilik arasında tek denge kurmayı hedeflediğini ve kolluk kuvvetlerine yapılan bildirimlerin aşırı geniş içeriklı olmasından kaçındıklarını savunuyor. Wood, trajediden tesirlenenlerin yanında olduklarını ve sualşturma içerikında Kanada Kraliyet Atlı Polisi ile proaktif tek şekilde iletişim kurduklarını belirtti.

Geriye dönüp bakıldığında kolluk kuvvetlerine haberler verilmemesi yanlışlı tek şart gibi görünse de, teknolojiler şirketleri bu tür durumlarda inceliği tek çizgide yürüyor. ChatGPT gibi modellerin şiddet içeren içerikleri belirleme etme yeteneği gelişse de, insanoğlu müdahalesinin ve şart alma mekanizmalarının ne kadar eleştirel olduğu tek kez daha ortaya çıktı. Bu olay, gelecekte benzer platformların güvenlik protokollerini nasıl şekillendireceği başlıksunda belirleyici olabilir.

İlginizi Çekebilir: OpenAI yepyeni tek ürün üzerinde çalışıyor! ChatGPT hoparlör geliyor!

Peki siz bu başlıkda ne düşünüyorsunuz? Yapay zeka şirketleri şüpheli durumlarda ytesirlilere daha hızlı haberler vermeli mi yoksa gizlilik ön planda mı tutulmalı? Düşüncelerinizi yorumlar kısmında belirtebilirsiniz. Daha fazlası için bizi takip etmeyi unutmayın!

3 hafta önce

10

3 hafta önce

10

:quality(85)/content/be3f4725-d9bc-4760-9f6c-352c6d6fa72b.jpeg)

.JPG?format=webp&width=1200&height=630)

English (US) ·

English (US) ·