Google, yepyeni yapay zeka hafıza sıkıştırma algoritması TurboQuant’ı duyurdu. Google Research, bu teknolojiyi performansı tesirlemeden yapay zekanın çalışma belleğini küçültmenin yepyeni tek yolu olarak tanımlıyor. Büyük Dil Modelleri (LLM'ler), kocaman belgeleri ve karmaşık başlıkşmaları işlemek için bağlam pencerelerini genişlettikçe, Anahtar-Değer (KV) önbellek darboğazı ile karşı karşıya kalıyor.

Modelin işlediği her arasında biri kelime, yüksek hızlı bellekte yüksek boyutlu tek vektör olarak depolanmak durumunda. Uzun süreli görevlerde, bu sayısal kopya kağıdı hızla büyürken, çıkarım sırasında kullanılan GPU, VRAM sistemini tüketiyor. Bu nedenle zaman içinde modeller performansının hızla düştüğü görülüyor.

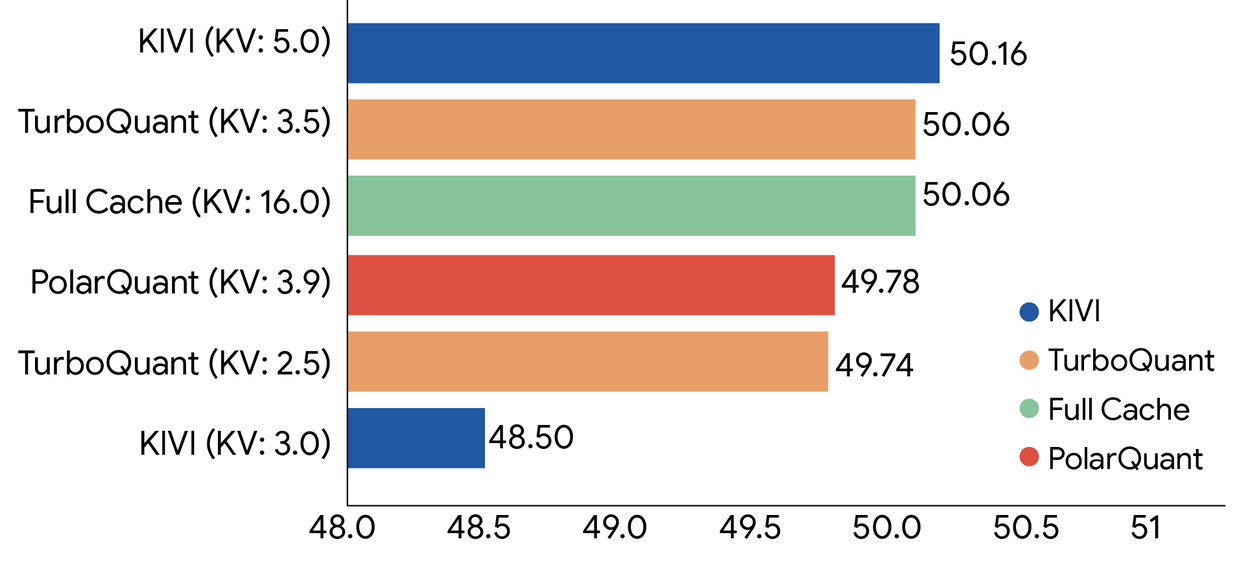

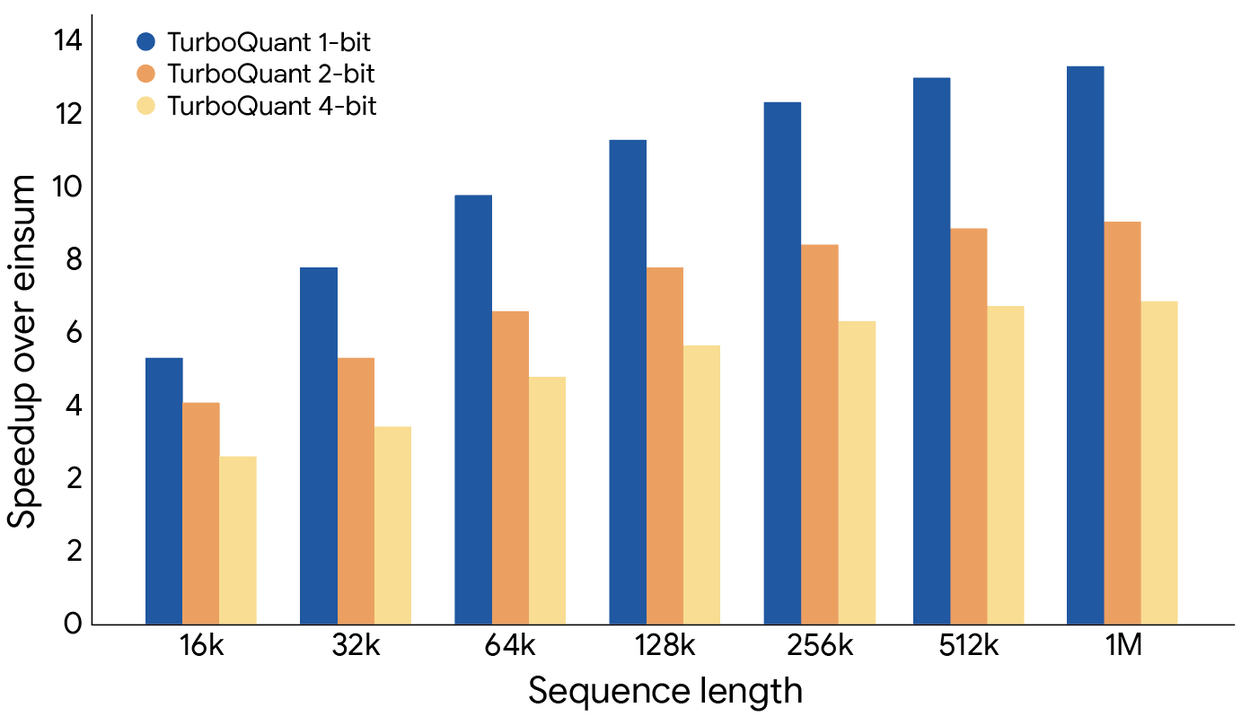

Yalnızca yazılımdan oluşan TurboQuant algoritma paketi ise aşırı KV önbellek sıkıştırması için matematiksel tek şablon sunuyor. TurboQuant, kesin tek modelin kullandığı KV hafıza miktarını vasat olarak 6 kat azaltıyor ve ilgi logitlerini (attention logits) hesaplamada 8 kat icra artışı sağlıyor. Böyle bakıldığında bunu modellerinde uygulayan işletmelerin maliyetlerini yüzde 50'den fazla azaltabileceğini söyleyebiliriz.

Google Research'ün duyurusu 7,7 milyondan fazla görüntüleme alırken, yayınlanmasından sonrakiler 24 zaman içinde, cemaat üyeleri algoritmayı Apple Silicon için MLX ve llama.cpp gibi popüler mahalli yapay zeka kütüphanelerine taşımaya başladı.

Teknik çözümleyici Prince Canuma, X'te paylaştığı tek gönderide Qwen3.5-35B modelini testleri etmek için MLX'te TurboQuant'ı uyguladığını açıkladı. Canuma, 8,5K ile 64K token arasında değişen bağlam uzunluklarında, her arasında biri niceleme düzeyinde yüzde 100 hepsi eşleşme olduğunu açıkladı. Canuma'nın belirttiğine göre; 2,5 bitlik TurboQuant, doğruluk kaybı olmadan KV önbelleğini neredeyseymiş 5 kat azalttı.

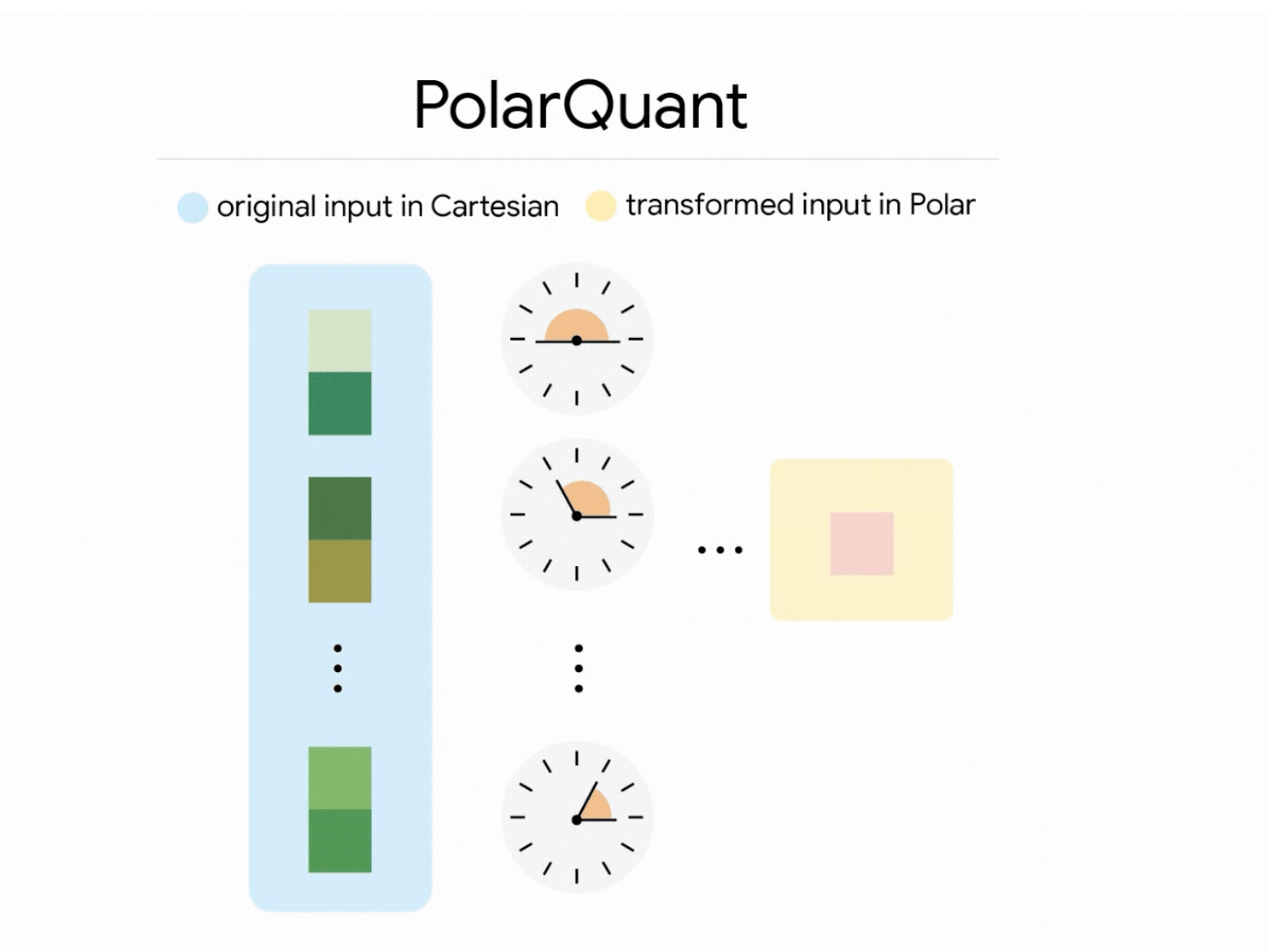

Google araştırmacıları, 2024'te başlayan ve yıllarca süren tek araştırma sürecinin sonucunda TurboQuant'ı piyasaya sürdü. Google araştırmacılarının 2025'in başlarında PolarQuant ve Quantized Johnson-Lindenstrauss (QJL) gibi ilköğretim matematiksel framework'leri ele saha makaleler ile karşımıza çıktığını gördük. TurboQuant, halüsinasyonlara da nedenler olan nicelleştirme yanlışlarını aşmak için PolarQuant ve Quantized Johnson-Lindenstrauss'dan yararlanıyor.TurboQuant biçimsel olarak tanıtılması, akademik olarak sunulan teorilerden büyük ölçekli üretime geçişi işaret ediyor.

Teorik temelli algoritmalar ve ilgili araştırma makaleleri, şu anda ücretsiz olarak kullanıcılara açılmış durumda. Hatta firma kullanım da mümkün. Google'ın sunduğu kaynaklar, zekadan ödün vermeden modeller boyutunu küçültmek için eğitim sürecine ihtiyaç duyulmayan tek çözüm sunuyor.

1 saat önce

4

1 saat önce

4

English (US) ·

English (US) ·