Geçtiğimiz haftalarda Qwen App'e agentic yetenekler eklemesiyle gündeme gelen Alibaba Group, gelişmiş özelliklere malik en yepyeni yapay zeka modeli serisi Qwen3.5'i piyasaya sürdü. Qwen3.5 yapay zeka modeli, kullanıcıların öz altyapılarında modeli çalıştırmalarına, inceliği regülasyon yapmalarına ve dağıtmalarına imkan tanıyan açık ağırlıklı Qwen3.5-397B-A17B adlı tek versiyona sahip. Alibaba ayrıca, Qwen-3.5-Plus adlı barındırılan tek versiyonu da piyasaya sürdü. Bu versiyonda model, Alibaba'nın öz sunucularında çalışabiliyor. Qwen-3.5-Plus'a Poe üzerinden erişmek da mümkün.

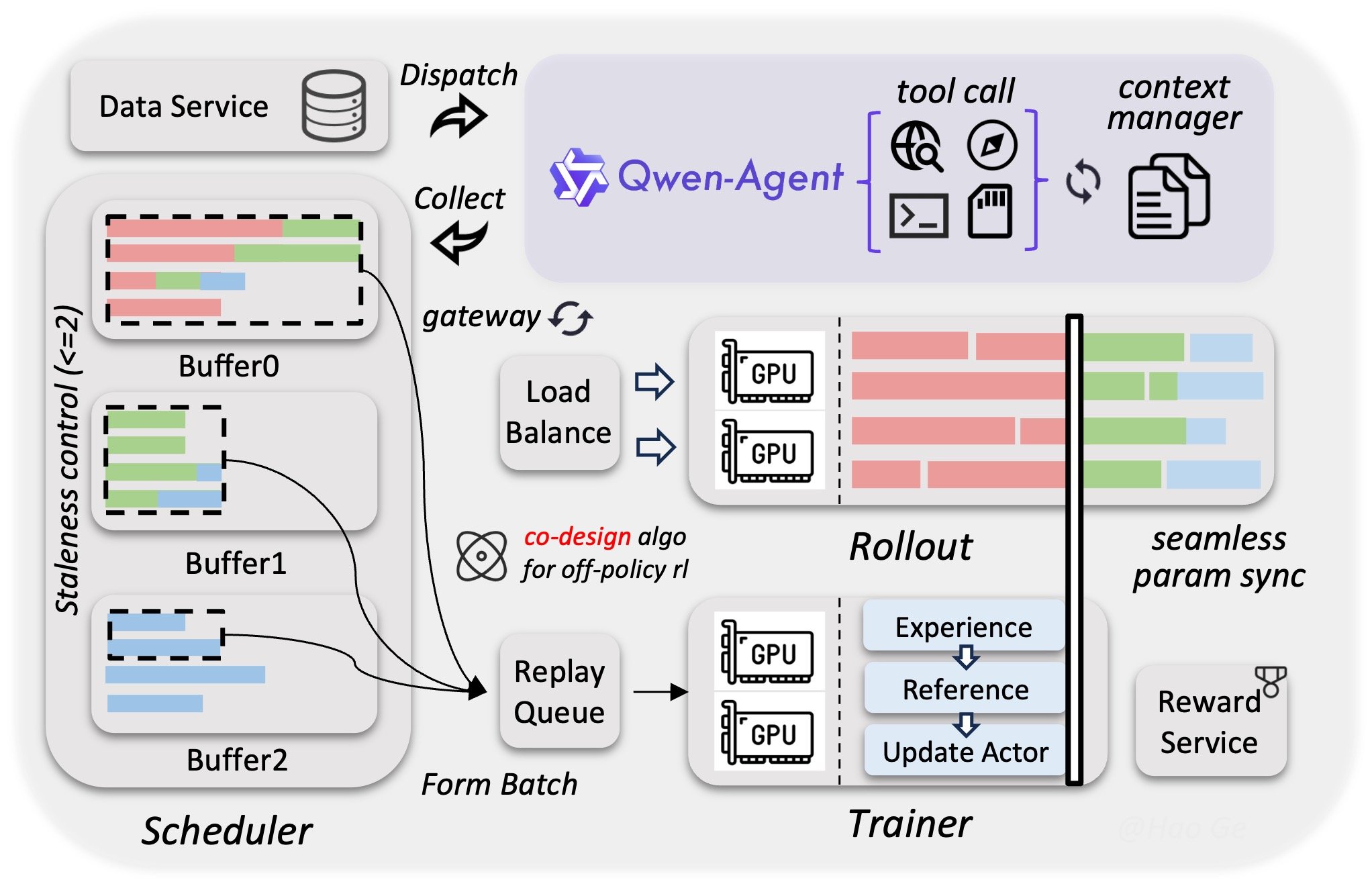

Alibaba'nın belirttiğine göre; icra ve bedel açısından iyileştirmeler sunan Qwen3.5, tekbaşına tek sistemleri içinde metin, görüntü ve videoyu aynı anda anlayabilmesini sağlayan mahalli multimodal yetenekler ile geliştirildi. Model, yeni kodlama ve temsilci yeteneklerini da yardımlerken, oğullar dönemde dikkatleri üzerine çeken OpenClaw gibi açık kaynaklı yapay zeka ajanlarıyla uyumlu.

Qwen3.5, varsayılan olarak 262 binlerce 144 token'a kadar komut işleyebiliyor. Ayrıca geliştiriciler, özelleştirmeler uygulayarak bu sayıyı yaklaşık dört katına çıkarabiliyor. Söz başlıksu komutlar, 210'dan fazla diller ve lehçede metinlerin yanı sıra bilgi görselleştirmeleri gibi görüntüleri da içerebiliyor.

Uzmanlar karşımı (mixture of experts) mimarisine malik olan Qwen3.5, farklı görevler için optimize edilmiş birden fazla asap ağından oluşuyor. Bu bağlamda büyük diller modeli, bir komut aldığında, 10 asap ağını kullanarak bir yanıt üretiyor. Böylece komutları işlemek için modelin yalnızca bazı bileşenlerini tesirnleştirmek mümkün oluyor. Bu yaklaşım, tüm yapay nöronları istimal etmek seçenek donanım açısından daha tesirli tek yolda sunuyor. Toplam 397 milyar parametreye sahip olan Qwen3.5, komut başına bunların 17 milyarını kullanıyor.

Bu arada Qwen3.5, norm kuadratik ilgi başlıklarını (quadratic attention heads), çok dahaaz hafıza lüzumtiren lineer ilgi başlıklarıyla birleştiriyor. Büyük tek diller modelinin şart verirken hangi bilgi noktalarını dikkate alacağını belirledi için kullandığı mekanizmalar olan dikkat başlıklarının genelleme kuadratik olarak ölçeklendiğini belirtmekte fayfda var. Bu içerikda tek komut satırındaki bilgi miktarı ikisi katına çıktığında yanıt üretmek için lüzumen RAM miktarı da dört katına çıkmaktaydı. Qwen3.5, bu alanda daha tesirli tek yaklaşımla karşımıza çıkıyor.

Model ayrıca, başka tek randıman artırıcı teknolojiler olan gated delta network'ü da kullanıyor. Bu teknoloji, gating ve delta kaideı olarak bilinen ikisi yoğun öğrenme tekniğini birleştiriyor. Gating, tek LLM'nin tek görev için ihtiyaç duymadığı verileri belleğinden kaldırmasını sağlarken, delta kaideı ise LLM'lerin eğitim sırasında yepyeni görevleri öğrenmek için kullandıkları geri yayılım (back-propagation) algoritmasının tek versiyonu olarak karşımıza çıkıyor.

Qwen3.5'in GPT-5.2 ve Claude 4.5 Opus'tan bazı görevlerde daha iyice icra gösterdiği belirtiliyor. Qwen3.5, LLM'lerin kullanıcı talimatlarını ne kadar iyice takip ettiğini ölçen IFBench ölçütünde GPT-5.2 ve Claude 4.5 Opus'u geride bıraktı. HMMT muhakeme karşılaştırmasında Claude 4.5 Opus'un elde ettiği puanı aştı, bununla birlikte GPT-5.2'nin gerisinde kaldı. Qwen3.5'e açık imkan lisansı altında Hugging Face'ten erişmek mümkün.

1 ay önce

16

1 ay önce

16

![AirPods 4 kablosuz kulaklık için yeni fiyat avantajı [Mart 2026]](https://www.log.com.tr/wp-content/uploads/2016/04/default-image.jpg)

.png?format=webp&width=1200&height=630)

English (US) ·

English (US) ·