Alibaba'nın Qwen ekibi, Qwen3.5 Small Model Serisi'ni tanıttı. Model serisinde Qwen3.5-0.8B, Qwen3.5-2B, Qwen3.5-4B ve Qwen3.5-9B mekan alıyor. Küçük ve hızlı icra için optimize edilen Qwen3.5-0.8B ve Qwen3.5-0.2B modelleri, pil ömrünün çok önemli olduğu cihazlarda prototip oluşturma ve dağıtım amaçlı olarak kullanılabilir.

Hafif ajanlar için güçlü tek multimodal temel olan Qwen3.5-4B, 262 binlerce 144 token bağlam penceresini mahalli olarak yardımliyor. Kompakt tek muhakeme modeli olan Qwen3.5-9B, önemli üçüncü taraf ölçütlerinde (benchmark) 13,5 kat daha büyük olan OpenAI'ın açık kaynaklı gpt-oss-120B modelini geride bırakıyor. Söz başlıksu ölçütlere çok dilli malumat ve lisansüstü düzeyde muhakeme da dahil.

Qwen3.5 Small serisinin teknikleri temeli, Verimli Hibrit Mimariye dayanıyor. Standart dönüştürücü (Transformer) mimarilerinden farklı olarak Alibaba, bu mimaride Gated Delta Networks (bir tür doğrusal dikkat) ile seyrek Mixture-of-Experts (MoE) birleştiriyor. Böylece şirket, genelleme küçük modelleri sınırlayan “bellek duvarını” ortadan kaldırmış oluyor. Gated Delta Networks kullanan modeller, daha yüksek verimi ve önemli ölçüde daha düşük erteleme süresi elde ediyor.

Ayrıca, doğal olarak çok modlu olan Qwen3.5 multimodal tokenlerde erkenden füzyon kullanılarak eğitildi. Bu sayede 4B ve 9B modelleri, daha önce on kat daha büyük modellerin lüzumtirdiği görsel manaa düzeyini sergileyebiliyor. Özellikle de arayüz öğelerini mütalaa etmek ya da tek videodaki nesneleri saydı gibi eylemler basitlıkla gerçekleştirilebiliyor.

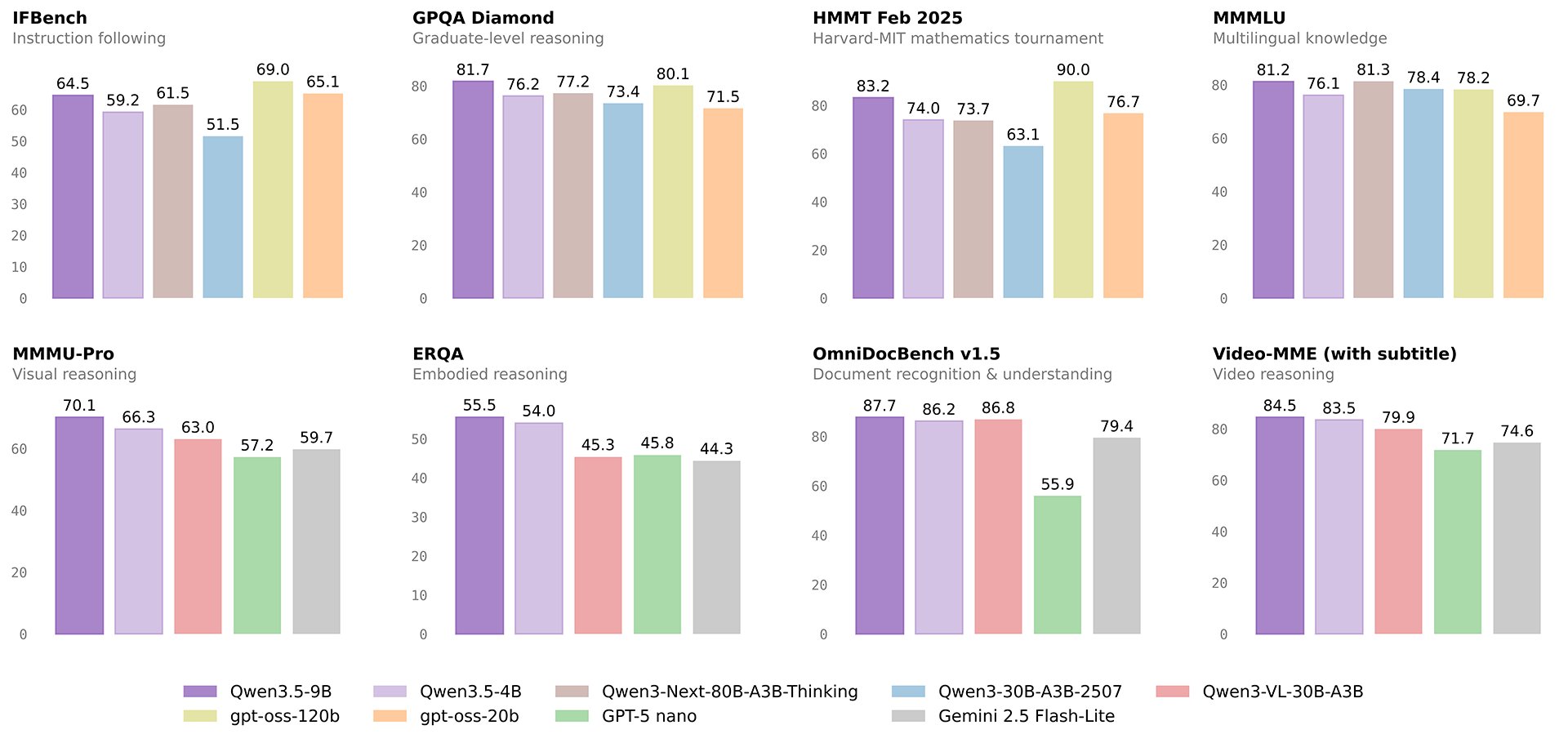

MMMU-Pro görsel muhakeme ölçütünde, Qwen3.5-9B 70,1 puan alarak 59,7 puan saha Gemini 2.5 Flash-Lite ve 63,0 puan saha Qwen3-VL-30B-A3B modellerini geride bırakıyor. GPQA Diamond karşılaştırmasında, 9B modeli 81,7 puan alarak, 80,1 puan saha ve parametre sayısı bağlı katından fazla olan gpt-oss-120b modelini ardında bırakıyor.

Video-MME (altyazılı) ölçütünde, Qwen3.5-9B 84,5 puan alırken, 4B 83,5 puan aldı. Böylece modeller, 74,6 puan saha Gemini 2.5 Flash-Lite'tan önemli ölçüde yüksek icra sergiledi. HMMT Şubat 2025 (Harvard-MIT matematik turnuvası) değerlendirmesinde, 9B modeli 83,2 puan alırken, 4B varyantı 74,0 puan aldı. 9B varyantı, OmniDocBench v1.5'te 87,7 puanla evrak tanıma alanında önder başlıkma yerleşti. Aynı zamanda, MMMLU'da 81,2 puanla en üst düzey çok dilli varlığını sürdürerek aynı değerlendirmede 78,2 puan saha gpt-oss-120b'yi geride bıraktı.

Modellerin ağırlıkları şu anda Apache 2.0 lisansları altında Hugging Face ve ModelScope'da küresel olarak kullanıma sunuluyor. Modeller, lüzumtiğinde özelleştirme karışmış bulunmak üzere firma ve ticari kullanım için yeğleme edilebilir.

2 hafta önce

7

2 hafta önce

7

.png?format=webp&width=1200&height=630)

English (US) ·

English (US) ·